📌 Das Wichtigste in Kürze

- Paradigmenwechsel: GEO ersetzt SEO – Ziel ist nicht mehr das Ranking in Ergebnislisten, sondern die Zitierung als Quelle in generativen Antworten von ChatGPT, Perplexity, Gemini & Claude.

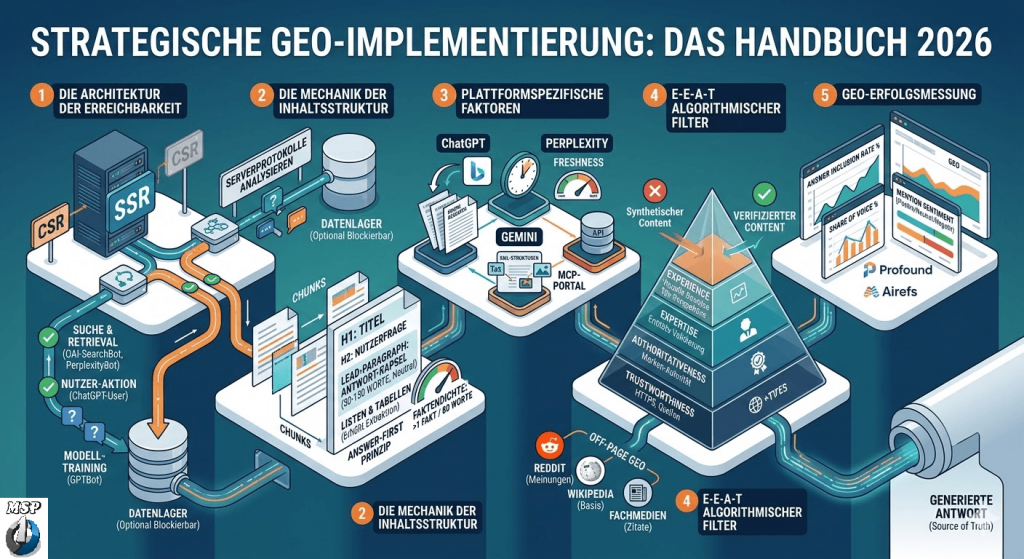

- Technische Grundlage: Zugang für Retrieval-Bots (OAI-SearchBot, PerplexityBot, Claude-SearchBot) priorisieren, Server-Side Rendering einsetzen, Blockaden durch CDNs (z.B. Cloudflare) vermeiden.

- Inhaltsstruktur: Answer-First-Prinzip (Antwort direkt unter H2), hohe Faktendichte (≥1 einzigartiger Fakt pro 80 Wörter), Einsatz von Tabellen & Listen erhöht Extraktionswahrscheinlichkeit um 30–40 %.

- Plattform-Trends:

- ChatGPT: setzt auf Information Gain & Bing-Index.

- Perplexity: belohnt extreme Aktualität (Recency Effect).

- Gemini: priorisiert multi‑modale Inhalte (Bilder, Videos) + E‑E‑A‑T.

- Claude: nutzt XML-Strukturen und MCP für direkte Datenanbindung.

- E‑E‑A‑T als Filter: Experience (echte Erfahrungsberichte), Expertise (verifizierte Autorenprofile), Authoritativeness (Backlinks von .edu/.org), Trustworthiness (transparente Quellen) entscheiden über Zitierwürdigkeit.

- Off‑Page Einfluss: Reddit ist mit ca. 3,5 % die meistzitierte Domain; Wikipedia definiert Entitäten; Bewertungsportale (G2, Capterra) liefern Daten für kommerzielle Vergleiche.

- Neue Messgrößen: Answer Inclusion Rate, Citation Velocity, Entity Clarity Score und Conversion from AI ersetzen klassische Keyword‑Rankings.

- Handlungsfelder 2026: Technisches Audit (Crawler‑Management, Content‑Modularisierung in Antwort‑Kapseln, gezielter Aufbau von Autorität auf Drittplattformen (Reddit, Fachmedien).

AIO Ranking Checkliste 2026

Optimierung für generative KIs (GEO – Generative Engine Optimization)

SEO vs. AIO Vergleich

Während Keywords an Bedeutung verlieren, steigen semantische Tiefe und Fakten-Dichte.

Ranking-Gewichtung

Die wichtigsten Signale, die KIs heute nutzen, um Quellen zu referenzieren.

Nuancen der KI-Engines

Unterschiede im Fokus zwischen den großen Sprachmodellen.

Inhalts-Struktur

- „Inverted Pyramid“: Antwort zuerst

- Klare Definitionen im ersten Absatz

- Nutzung von Tabellen für Daten

Vertrauen & E-E-A-T

- Zitierfähige Primärquellen nennen

- Experten-Bios mit Fachnachweisen

- Verlinkung zu .gov/.edu Quellen

Technik & RAG

- Schema.org Markup (FAQ, Article)

- TTFB unter 200ms für Crawler

- Robots.txt für KI-Bots offen halten

Entitäten & Fakten

- Eindeutige Fachbegriffe statt Fluff

- Aktuelle Zahlen (Stand: 2026)

- Informationsdichte erhöhen

Strategische Analyse und Implementierung: Das Handbuch der Generativen Engine Optimization (GEO) 2026

Die Architektur der technischen Erreichbarkeit für KI-Systeme

Die Grundlage jeder GEO-Strategie bildet die Gewährleistung, dass generative Systeme physisch in der Lage sind, auf die relevanten Inhalte zuzugreifen. Im Jahr 2026 hat sich die Landschaft der Web-Crawler differenziert, was eine nuancierte Herangehensweise an die Konfiguration der Server-Infrastruktur und der Sicherheitsinstanzen erfordert. Ein wesentliches Hindernis für die Sichtbarkeit in KI-Suchmaschinen stellt die fehlerhafte Konfiguration von Inhaltsverteilungsnetzwerken (CDNs) und Sicherheits-Plug-ins dar. Beispielsweise hat Cloudflare Standardkonfigurationen eingeführt, die KI-Bots blockieren, was dazu führen kann, dass Webseiten ohne explizite Anpassung für Systeme wie ChatGPT oder Perplexity unsichtbar bleiben.

Die Analyse der Serverprotokolle ist daher unumgänglich, um die Präsenz von User-Agents wie ChatGPT-User oder ClaudeBot zu verifizieren. Es ist dabei von kritischer Bedeutung, zwischen verschiedenen Kategorien von Bots zu unterscheiden. Trainings-Crawler wie GPTBot sammeln Daten für die zukünftige Modellentwicklung, während Retrieval-Crawler wie OAI-SearchBot oder Perplexity-User in Echtzeit auf Anfragen reagieren, um aktuelle Antworten zu generieren. Eine moderne Strategie muss den Zugriff für Retrieval-Bots priorisieren, um die Chance auf Zitate in den unmittelbaren Antworten der Nutzer zu wahren.

| Crawler-Kategorie | Primäre User-Agents | Strategische Implikation für 2026 |

| Suche & Retrieval | OAI-SearchBot, PerplexityBot, Claude-SearchBot | Entscheidend für Echtzeit-Zitate; Freigabe zwingend erforderlich. |

| Nutzer-Aktion | ChatGPT-User, Claude-User, Perplexity-User | Getriggert durch spezifische Anfragen; hohe Relevanz für RAG-Prozesse. |

| Modell-Training | GPTBot, ClaudeBot, Google-Extended, Meta-ExternalAgent | Langfristige Modellverbesserung; Blockierung möglich ohne Verlust der Suchsichtbarkeit. |

| Mixed Purpose | Googlebot, Bingbot | Indexierung für traditionelle Suche und KI-Features; Blockierung führt zu SEO-Verlust. |

Ein technischer Aspekt, der im Jahr 2026 oft übersehen wird, ist die Abkehr von reinem Client-Side Rendering (CSR). Da generative Crawler primär das vom Server zurückgegebene HTML analysieren und JavaScript oft nicht oder nur verzögert ausführen, bleiben interaktive Elemente wie Slider, Tabs oder durch JavaScript geladene Preislisten für die meisten KI-Systeme unsichtbar. Um die Extraktion von Informationen zu garantieren, müssen alle geschäftskritischen Daten im initialen HTML-Payload enthalten sein (Server-Side Rendering). Ebenso stellen Paywalls und Login-Bereiche unüberwindbare Hürden dar; Informationen, die nicht öffentlich zugänglich sind, können nicht als Grundlage für eine KI-generierte Antwort dienen.

Die Mechanik der Inhaltsstrukturierung: Answer-First und Chunking

In der Ära der Retrieval-Augmented Generation (RAG) arbeiten KI-Modelle nicht mehr mit ganzen Webseiten als kleinster Informationseinheit, sondern mit Textsegmenten, den sogenannten „Chunks“. Die algorithmische Auswahl einer Quelle hängt davon ab, wie präzise ein solches Segment auf die Vektordarstellung einer Nutzeranfrage passt. Dies erfordert eine radikale Umgestaltung der Inhaltsarchitektur hin zum „Answer-First“-Prinzip.

Professionelle GEO-Inhalte müssen so gestaltet sein, dass die Kernantwort auf eine potenzielle Frage unmittelbar unter der entsprechenden H2-Überschrift platziert wird. Die ersten 50 bis 150 Wörter eines Abschnitts sind entscheidend; sie müssen die Information in einer neutralen, extrahierbaren Form präsentieren. Diese „Antwort-Kapseln“ erleichtern es der generativen Engine, den Inhalt ohne komplexe Umformulierung in die finale Antwort zu integrieren. Ein weiterer wichtiger Faktor ist die semantische Hierarchie. Durch die Verwendung von H1, H2 und H3 Tags wird den Systemen signalisiert, welche Themenbereiche abgedeckt werden, was die Wahrscheinlichkeit erhöht, dass die Passage bei einer relevanten Anfrage als „Ground Truth“ erkannt wird.

| Strukturelement | Funktion im GEO-Kontext | Optimierungsziel |

| H2/H3 Überschriften | Fragenorientierte Strukturierung | Deckungsgleichheit mit Nutzerfragen (Search Intent). |

| Lead-Paragraphen | Direkte Antwortblöcke (Answer Islands) | Maximale Relevanz in den ersten 150 Wörtern. |

| Listen & Tabellen | Strukturierung von Vergleichen/Prozessen | Erhöhung der Extraktionswahrscheinlichkeit um 30-40%. |

| Kurze Absätze | Erleichterung des Chunking-Prozesses | Maximale Informationstiefe bei 2-3 Sätzen pro Absatz. |

Die empirische Forschung zeigt, dass eine hohe Faktendichte („Fact Density“) die Zitationswahrscheinlichkeit massiv steigert. Im Jahr 2026 hat das Verhältnis von verifizierbaren Fakten zu Worten die klassische Keyword-Dichte als primäres Qualitätssignal abgelöst. Seiten, die ein Verhältnis von mindestens einem einzigartigen Fakt pro 80 Wörter aufweisen, werden mit einer 4,2-fach höheren Wahrscheinlichkeit von Systemen wie ChatGPT zitiert. Dies unterstreicht die Notwendigkeit, Inhalte mit proprietären Daten, statistischen Werten und klaren Definitionen anzureichern, anstatt auf werbliche Floskeln zu setzen.

Plattformspezifische Nuancen und Ranking-Faktoren

Obwohl die grundlegenden Prinzipien der GEO plattformübergreifend gelten, weisen ChatGPT, Perplexity, Gemini und Claude spezifische Mechanismen auf, die bei der Optimierung berücksichtigt werden müssen.

ChatGPT und die Bedeutung des Bing-Index

ChatGPT und die darauf basierenden Funktionen von SearchGPT greifen maßgeblich auf den Index von Bing zurück, um Echtzeit-Informationen zu beziehen. Eine grundlegende Strategie für ChatGPT-Rankings beinhaltet daher eine umfassende Optimierung für Bing. Dazu gehört eine saubere On-Page-Struktur, die Verwendung von Schema-Markup und die Sicherstellung einer schnellen Crawlbarkeit. Ein Alleinstellungsmerkmal von SearchGPT ist der Fokus auf „Information Gain“. Das System vermeidet es, Quellen zu zitieren, die lediglich Informationen wiederholen, die bereits in den Trainingsdaten des Modells vorhanden sind. Daher müssen Marken originäre Forschung, aktuelle Fallstudien oder exklusive Marktdaten veröffentlichen, um als zitationswürdig eingestuft zu werden.

Perplexity AI: Die Vorherrschaft der Aktualität

Perplexity AI zeichnet sich durch eine extrem aggressive Gewichtung der Aktualität aus. Der sogenannte „Recency Effect“ führt dazu, dass Inhalte bereits nach zwei bis drei Tagen ohne Aktualisierung an Relevanz verlieren können. Für Branchen mit hoher Dynamik, wie Technologie oder Finanzen, ist ein täglicher Update-Zyklus oder zumindest die Implementierung von Zeitstempeln und Änderungsprotokollen unerlässlich. Perplexity nutzt zudem einen mehrstufigen Filterprozess, bei dem ein „L3 Reranker“ die Kandidatenmenge der Suchergebnisse bewertet. Quellen mit hohem Nutzervertrauen (z. B. offizielle Dokumentationen, GitHub, LinkedIn-Profile von Experten) werden bevorzugt, während Seiten mit negativen Nutzersignalen oder mangelnder Autorität systematisch aussortiert werden.

Google Gemini und AI Overviews: Die Multi-Modale Dimension

Gemini ist tief in das Google-Ökosystem integriert und nutzt den bestehenden Search-Index sowie den Knowledge Graph zur Verifizierung von Fakten. Ein entscheidender Faktor für die Sichtbarkeit in den AI Overviews ist die Integration von multi-modalen Inhalten. Daten deuten darauf hin, dass Seiten, die Text mit qualitativ hochwertigen Bildern (ImageObject) und kurzen Erklärvideos (VideoObject) kombinieren, eine um bis zu 317 % höhere Wahrscheinlichkeit haben, in den KI-Zusammenfassungen zitiert zu werden. Gemini führt zudem einen Echtzeit-Abgleich gegen autoritative Datenbanken durch; Behauptungen, die nicht durch externe Quellen (Studien, offizielle Statistiken) gestützt werden, führen oft zum Ausschluss der Seite aus der Antwortgenerierung.

Anthropic Claude: XML-Strukturen und der Model Context Protocol (MCP)

Anthropic Claude zeigt eine technologische Präferenz für hochstrukturierte Datenformate. In der Dokumentation wird explizit die Verwendung von XML-Tags zur Trennung von Anweisungen, Kontext und Daten empfohlen. Im Gegensatz zu anderen Modellen, die flexibler mit Markdown umgehen, wurde Claude gezielt darauf trainiert, XML-Begrenzungen zur präzisen Extraktion von Informationen zu nutzen.

Eine bahnbrechende Entwicklung des Jahres 2026 für Claude ist das Model Context Protocol (MCP). MCP fungiert als standardisierte Schnittstelle (ähnlich einem „USB-C Port“ für KI), über die Claude direkt auf Unternehmensdatenbanken, APIs oder Dateisysteme zugreifen kann. Unternehmen, die ihre Daten über MCP-Server bereitstellen, können eine nahezu 100-prozentige Genauigkeit bei der Informationswiedergabe durch Claude erreichen, da das Modell nicht mehr auf das fehleranfällige Scraping von HTML angewiesen ist.

| Plattform | Fokus-Merkmal | Kritischer Erfolgsfaktor |

| ChatGPT | Information Gain | Originäre Daten und Bing-Index-Sichtbarkeit. |

| Perplexity | Freshness | Tägliche bis wöchentliche Update-Zyklen. |

| Gemini | Multi-Modalität | Kombination von Text, Bildern und Videos + E-E-A-T. |

| Claude | XML & MCP | Strukturierte Datenformate und direkte API-Anbindung. |

E-E-A-T: Vertrauen als algorithmischer Filter

In einer Zeit, in der KI-generierte Inhalte massenhaft produziert werden, ist die Verifizierung der Quelle durch die E-E-A-T-Prinzipien (Experience, Expertise, Authoritativeness, Trustworthiness) zum wichtigsten Filter der generativen Engines geworden. Im Jahr 2026 sind diese Signale keine optionalen „Best Practices“ mehr, sondern aktive Filter in der Retrieval-Pipeline.

Die Rolle der „Experience“ im KI-Zeitalter

Das „E“ für Experience ist das stärkste Differenzierungsmerkmal gegenüber rein synthetischen Inhalten. KI-Modelle suchen gezielt nach Anzeichen dafür, dass der Verfasser reale Erfahrungen mit dem Thema hat. Dies wird durch die Verwendung einer persönlichen Perspektive („In unseren Tests…“), das Aufzeigen von spezifischen Problemen und deren Lösungen sowie durch visuelle Beweise (Originalfotos, Screenshots mit Zeitstempeln) erreicht. Dokumentierte Fehler und deren Korrekturen signalisieren den Systemen eine Authentizität, die durch LLMs allein schwer zu fälschen ist.

Entitäts-Validierung und Autoren-Footprints

Die Identität des Autors muss über verschiedene Plattformen hinweg konsistent und verifizierbar sein. KI-Systeme führen eine „Entity Resolution“ durch, um sicherzustellen, dass ein Experte tatsächlich die Kompetenz besitzt, über ein Thema zu schreiben. Ein robuster digitaler Fußabdruck, bestehend aus verifizierten LinkedIn-Profilen, Publikationen in Fachzeitschriften und Zitationen auf autoritativen Drittseiten, ist entscheidend. Die Verwendung von Person Schema-Markup, das auf diese Profile verlinkt, unterstützt diesen Prozess der Identitätsfeststellung maßgeblich.

Statistiken belegen die Korrelation zwischen Entitätsdichte und Sichtbarkeit: Seiten, die mehr als 15 anerkannte Entitäten (Personen, Organisationen, Fachbegriffe) in einem logischen Zusammenhang präsentieren, zeigen eine 4,8-fach höhere Wahrscheinlichkeit, in Google AI Overviews ausgewählt zu werden.

| E-E-A-T Signal | Implementierungsmethode | Wirkung auf KI-Modelle |

| Experience | Fallstudien, eigene Testdaten, „Wir“-Perspektive | Unterscheidung von KI-generiertem „Slop“. |

| Expertise | Verknüpfung mit akademischen/beruflichen Titeln | Erhöhung der Glaubwürdigkeit bei Fachfragen. |

| Authoritativeness | Backlinks von .edu oder .org Domains, Presseerwähnungen | Aufbau einer markenweiten Autorität im Wissensgraphen. |

| Trustworthiness | Transparente Quellenangaben, HTTPS, Impressum | Reduktion des „Halluzinationsrisikos“ für das Modell. |

Off-Page GEO: Die Macht von Reddit, Wikipedia und Drittquellen

Ein signifikanter Teil der Informationen, die generative Engines über eine Marke oder ein Produkt erhalten, stammt nicht von der eigenen Webseite, sondern von Drittplattformen und Community-Diskussionen. KI-Systeme nutzen diese Quellen als Validierung für Markenversprechen.

Reddit als primäre Datenquelle

Reddit hat sich im Jahr 2026 zur wichtigsten Quelle für authentische Meinungen und Nutzererfahrungen entwickelt. Forschungsberichte zeigen, dass Reddit über alle großen KI-Plattformen hinweg die am häufigsten zitierte Domain ist (ca. 3,5 % aller Zitate). Besonders OpenAI hat durch eine direkte Partnerschaft einen tiefen Zugang zu Reddit-Daten, was bedeutet, dass Empfehlungen in Subreddits einen massiven Einfluss auf die Antworten von ChatGPT haben. Marken müssen daher Strategien entwickeln, um in diesen Communities organisch präsent zu sein und echte Nutzerdiskussionen zu fördern.

Die Rolle von Wikipedia und Experten-Verzeichnissen

Wikipedia fungiert weiterhin als Rückgrat für die Definition von Entitäten und deren Beziehungen im Knowledge Graph. Obwohl die menschlichen Seitenaufrufe sinken, bleibt Wikipedia eine der vertrauenswürdigsten Quellen für KI-Modelle, um die grundlegende Identität eines Unternehmens oder einer Person zu verifizieren. Zusätzlich spielen branchenspezifische Verzeichnisse und Bewertungsplattformen wie G2, Capterra oder Clutch eine entscheidende Rolle bei kommerziellen Vergleichen. Wenn ein System wie SearchGPT nach den „besten CRM-Systemen“ gefragt wird, stammen die Daten oft aus den hierarchisch strukturierten Bewertungslisten dieser Portale.

Die Messung des Erfolgs im GEO-Ökosystem

Traditionelle SEO-Metriken wie das Keyword-Ranking verlieren an Aussagekraft, wenn die Antwort direkt auf der Ergebnisseite ohne Klick generiert wird. Die Messung der GEO-Performance erfordert neue Kennzahlen und Tools.

Innovative Metriken für 2026

Marken müssen den Fokus von Klicks auf „Einfluss“ verschieben. Die Answer Inclusion Rate gibt an, wie oft eine Marke in KI-Antworten zu relevanten Themen erscheint. Der Share of Voice (SoV) misst den prozentualen Anteil der eigenen Informationen an der gesamten generierten Antwort. Ein weiterer wichtiger Faktor ist das Mention Sentiment, also die Bewertung, ob die KI die Marke in einem positiven, neutralen oder negativen Licht darstellt.

| Metrik | Definition | Strategischer Wert |

| Answer Inclusion Rate | Häufigkeit der Erwähnung in KI-Antworten | Maßstab für die Relevanz als Wissensquelle. |

| Citation Velocity | Frequenz der Zitate durch Drittquellen | Indikator für wachsende Markenautorität. |

| Entity Clarity Score | Eindeutigkeit der Markenzuordnung im Wissensgraphen | Verhindert Verwechslungen und Halluzinationen. |

| Conversion from AI | Leads/Verkäufe über KI-Referral-Links | Direkte wirtschaftliche Erfolgsmessung. |

Analyse-Tools und GEO-Software

Der Markt für GEO-Tools ist 2026 bereits hochgradig spezialisiert. Während traditionelle Tools wie die Google Search Console erste Einblicke in AI Overviews bieten, liefern spezialisierte Plattformen wie Profound, Otterly AI oder Airefs tiefe Analysen über mehrere Modelle hinweg. Diese Tools ermöglichen es, Halluzinationen zu identifizieren (z. B. wenn eine KI falsche Funktionen eines Produkts erfindet) und gezielt Content-Lücken zu schließen, die Wettbewerber für Zitate nutzen.

Zukunftsgerichtete Handlungsempfehlungen für die GEO-Strategie

Die Transformation zur generativen Suche ist kein vorübergehender Trend, sondern eine fundamentale Neugestaltung des Informationszugangs. Um im Jahr 2026 und darüber hinaus erfolgreich zu ranken (beziehungsweise zitiert zu werden), müssen Unternehmen eine zweigleisige Strategie verfolgen: technische Exzellenz in der Bereitstellung maschinenlesbarer Daten und der Aufbau einer unanfechtbaren menschlichen Autorität.

Operative Checkliste für die Umsetzung

Ein strukturierter Ansatz beginnt mit dem technischen Audit (Quartal 1), bei dem die Erreichbarkeit für Bots und sowie Schema-Markup im Vordergrund stehen. Es folgt die Content-Modularisierung (Quartal 2), bei der bestehende Top-Inhalte in Antwort-Kapseln mit hoher Faktendichte umgewandelt werden. Parallel dazu muss der Aufbau von Autorität erfolgen, indem Experten der Marke auf Drittplattformen wie Reddit und in Fachmedien positioniert werden.

Abschließend lässt sich festhalten, dass GEO im Jahr 2026 die Disziplin ist, Vertrauen in großem Maßstab zu verdienen. Marken, die ihre Systeme so optimieren, dass sie als „Source of Truth“ für KI-Engines agieren, werden nicht nur ihren organischen Traffic stabilisieren, sondern ihren Einfluss auf die Kaufentscheidungen der Nutzer, die zunehmend über KI-Assistenten getroffen werden, massiv ausbauen. Die Sichtbarkeit wird in Zukunft nicht mehr durch das „Gefundenwerden“ verdient, sondern durch das „Benutztwerden“ als vertrauenswürdige Wissensbasis durch die Maschinen, die unsere Realität zusammenfassen.

Primärquellen & Recherche-Grundlagen

- Anthropic News (2026): Claude Sonnet 4.6 Technical Requirements and MCP Tool Integration. (Fokus: Technische Standards für die Einbindung von Webinhalten in Claude).

- Omnius SEO Blog: How to Rank on Perplexity AI: Source Verification and Credibility Signals. (Fokus: Zitierfähigkeit und Echtzeit-Indexierung).

- Fuel Online Strategy Guide: SearchGPT (ChatGPT Search) Optimization: From Fact Density to Citation. (Fokus: Informationsdichte und Antwort-Priorisierung).

- Wellows Digital: Google Gemini AI Overviews: Advanced E-E-A-T and Schema Mapping. (Fokus: Vertrauenssignale und Knowledge Graph Integration).

- LLMRefs Research: Generative Engine Optimization (GEO): Tier 1 API Access and LLM-Friendly Content Structure. (Fokus: Strukturierte Daten und maschinenlesbare Inhalte).

- Strategic Nerds Analysis: Making Your Content AI-Friendly in 2026 – Technical SEO Checklist. (Fokus: Crawler-Management und RAG-Systeme).

- Fern API Documentation: Technical Standards for AI-Crawlable Documentation and MCP Standards. (Fokus: API-gestützte Inhaltsbereitstellung).

Taucht Ihr Unternehmen in KI-Suchmaschinen auf? Jetzt kostenlos und unverbindlich von uns überprüfen lassen!

Boris Alexeev, M.A.

SEO Strategist mit 24 Jahren Erfahrung